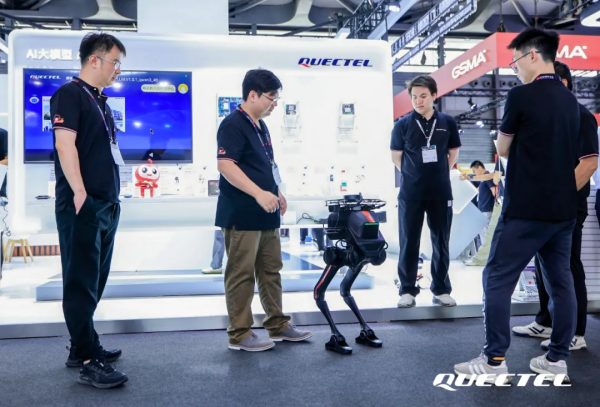

�w��ԭ����κ���g/�ģ���2025MWC�Ϻ������ь��C������ʾ�Ŀ˾��Ҋ�T���^�����s�ڲ����������hͨ��չ�_ǰ��һ�_�aƷ�M�Ќ�Ԓ������

�@�_�C����ԏ����P�ڡ���N���c��׃�ν������g�Ĺ��£��ܶ��I����ʿ�_ʼ�������Լ��Ă��y�O���Ƿ�Ҳ��Ҫ����һ�����`����X�����팍�F�Z����������Ϣ��ԃ�cָ����е�һϵ�й��ܡ�

���ˣ������ȏ�ϵ�y�ܘ��ĽǶȁ������£��@�_�C��������Γ����ˡ��`����X���ġ�

���C�������ˡ��`����X��

�^��֮�������뵽�����ИI�ęC���ˮaƷ�������P�I�������hͨ��չʾ�ęC���˲�����һ���ںϷ��������C���˱��w�����H�����ṩ��ͨ�^�B��һ�K���d���h������AIģ�MSG885G�����ɶ˂ȱ���ģ�͵����ذ壬������C���˽�Q˼���c���_ָ��Ć��}���ڌ��F�������棬�t���������L��к����ȣ��Ķ����F���F���^�����Z����֪��

���hͨ����2025MWC�Ϻ����g�l���ġ�Robrain AI�C���˽�Q����������ͬ����N��һ�ӣ�Ѹ���C���˫@�á��`����X����ԓ�������Ä��µĶ��ƅfͬ�ܘ��������L���ʰ�����g������ں϶˂������c�ƶ˴�ģ�̓��ݣ��x��C���˽ӽ���ġ�˼�����c���A ����������Ч������AIģ�Ͷ��ơ��p�����������t����푑����P�I�����ƄәC���ˏġ��Cе���С��S���顰���Ӹ�֪������˼������Ȼ��������AI�����w��

���˽⣬���ε���ʾ�C���˲��õ���һ���p���ںϷ�������̎�����������ף��ஔ��ֻ�������O���ṩһ�w�����X���������x������ڱ��w����죬�����C���˓��С��`�ꡱ�����ڸ�ģ�K����������ϵ�y���Ӻ��Ρ�

ͬ�r�����hͨ��߀�ṩ����ںϷ���������һ�w��ܛӲ���OӋ�������f���ÙC���˱��w����r�£����C���˴��X�����cС�X����϶���һ���M����Ҫ�aƷ�ˆT����һ���_�l�����������C�ɿ��Ը��ߣ������a�^����Ҳ���߳ɱ����ݡ�

�����ڙC���˵���K�w�É��c����f�����ںϷ����Ȳ��ġ��������X���c����L���������܉�l�]���ӵ����������P�I���ڡ�

�����������X�����ϡ���L����

����ʾ�C���˵��\�D���́�������Ҫ�֞��������֣���֪���Q�ߡ����С�

���ڙC���˲����Z�������ķ�ʽ�������ڸ�֪����Ҫ�M��ǰ���W̎�������͕����е��s�����_�������M�н�����Դ���ݣ���K���ʴ_����Ϣ���݂��f�o�Q�ߌӡ�

�ڛQ�ߌ�ͨ�^��D�R�e��ͨ�^���h��&�ƻ�ϴ�ģ���M��ָ��̎�����˂ȴ�ģ���cRAG����֪�R��Y�ϣ��_�����r�����еĿ��ٷ����c�ʴ_�����ƶ˴�ģ�͵Ľ����Ñ���һЩ��ԃ���ᆖ�܉�ͨ�^�W�@ȡ��Ϣ��

��K̎����Ŀ���ָ�ͨ�^�C���ˈ��У��C����Ҳ�����Z���������ʽ�M�з�����

�@Ȼ����֪�ӵġ���L�����c�Q�ߌӡ��������X���ĮaƷ�����������˱���C���˵ġ���Ȥ�`�ꡱ��

��Robrain AI�C���˽�Q������߀����ȫ�·���l̎���������C�����܉� ��Ҋ�������ܡ� ���塱����2025MWC�Ϻ��ĕ����h���������F���������s��������ͬչ�_������Ҳ�ڲ��r�������Լҵ��������ھ���҃ȭh����߀�����������}��ͬ�r���C���˃Ȳ�Ҳ�����\�D�^���а������ӡ�늙C���L�ȵ�������

���hͨ��Robrain AI�C���˽�Q����ͨ�^�������L���ʰ��+ȫ�·���l�㷨������C���������ˡ���L�����Ĺ��ܡ�6�����L����ֲ����O��ĈA�h�ϣ�����360��ȫ��ʰ���������䛾��x���_10�ף������ʸ��_95%����10.0���DOA���ȿ��Դ_��Դ�^��������

��Ч������̖���ռ������P�㷨������ȥ�����еĸɔ_��̖�Լ����]���g�еĻ�����ͨ�^AI����@�Æμ�������ͬ�r߀���Ԅ��{�����l���棬ݔ�����������ں��m�ķ��ȡ�

����������Դ��λ���������͡����롢ȥ��푡��Ԅ������Լ��Z���ѵ�һϵ��ǰ�˔���̎�����_���˴�ģ���R�e�Ĝʴ_�ʡ������hͨ�ŮaƷ�����������ʾ��

���������˵������ݔ�뵽���������X����Robrain AI�C���˽�Q�����еĶ�&�ƻ�ϴ�ģ��ͬ�ӷֹ����_�����У������C�����܉���ͬ����һ���ڜ�ͨ�������������r���������Ҳ���ه�ھW�j�h����85%���\�㌢�ڶ˂ȴ�ģ���M�У������r��С��1�룬���Ҳ�ռ���^�������YԴ������һЩ�c�aƷ���P�Ć��}���˂ȴ�ģ��߀���xȡ����RAG֪�R�죬�M���̘I�����p��ͨ�ô�ģ���ڌ��I�I�����׳��F�ġ����X�����}�����hͨ�ŮaƷ���������@һ�^�̱����飺����ģ���ڱ����M�С��_����ԇ�����C������ͬ�Ԏ�һ�����،W�ԡ����ijɱ��ȿ��]��RAG�ķ�ʽҲ����I�������픵�������M��˽��Ӗ�����M�YԴ���٣�����ظ��졣

�����е��ƶ˴�ģ�̈́t�ṩ�˔U�����w������������ͨ�^�cͨ�ô�ģ���M�к����������p�ɽ��뻥�W�YԴ�������M�Ѓ����������������ṩӰ��ʘ����ա�������2025MWC�Ϻ���չ�^��ʾ�У����F���^��ԃ�������������ô�ӣ����ĕr����ʾ�C�����܉���������ش�

���H�ϣ����hͨ����2025MWC�Ϻ�չʾ�ęC���˲��ǡ��������X��+����L�����@������֮�ϵĹ������������hͨ�Ŷ˂�AI���w��Q����������3���ϵ�Ҽ���l����ȫ����AI����C���ˣ��ڟo�����������롢�o�W�j�B�ӵĭh���£��ɿ����Ҝʴ_�������Ñ�ͨ�^��Ȼ�Z�������ָ�����D����Ч���ͨ�����졢�t���I��RAG����ָ����Ƶ��΄ա�ԓ�C���˴��d��ͨQCS8550ƽ�_������D�R�eС��1s��Prefill�r�gС��2s��ͬ�r�����^15 tokens/s��a����Ҳ�_���˽����Č��r�ԡ�

�����@�_�܉����һ�������������ęC���ˣ����������܁��������е�ÿ�����������hͨ�����ڜʂ䌢�@��������֮�ϡ��������M���Mһ��������

���������������

���ҵĂ��˽��h�ǰѴ�ģ�ͮ�����һ�ӡ������±�ʾ����ģ�ͷ�����������ı����Z�����A�ϣ�����ҕ�X������֧�֣��Õr���C���ˌ��܉�ͨ�^ҕ�X���������ߵı��飬�Ķ������͔Uչ�������m���ԡ��c��ͬ�r�����c��������Ľ����^���У�ҕ�XҲ�����C���˸��õ��Д��fԒ�˵��D�Q����K��ҕ�X���c�ı����Z��һ�������əC���˵Ķ�ģ�B��֪������

���hͨ��߀����˼������ν�Q��ǰTransformer�ܘ��µ�������ģ�͌������ȴ����ı��^��Ć��}��Ŀǰ�����Pע��Transformer�ܘ���RWKV���Z��ģ�ͣ�������SG885Gģ�M�ϳɹ��\��RWKV7ģ�ͣ�����C���ˎ�������Ч���ȴ�ռ�ø�С��������

���Z�����������M���棬���hͨ��ͬ�Ӿ۽��ڶ�S��֪�ķ����ϡ����磬��Ŀǰ�Ľ����_���h�����Z����߀ֻ�ǻ��A���棬�����Ҫ�܉��i�����ˌ�����R�e�_��������Ҫ�����y�R�e����Ę���ѡ�ͬ�r���y��Դ�c��Ę�����w�ĽY�ϣ��������ڱ��ֽ�����B���Ķ��������ʴ_���Z�x�Дࡣ��Ę�i������Ҳ�����ڶ��ˌ�Ԓ�У�ͨ�^�����i����Ę���ГQ��Ԓ��Ϣ���ռ������⣬�����Y�������ĭh�������hͨ��Ҳ�����C�����܉��Ա��^�Ѻõķ�ʽ�M�б��_�������f�������ˡ���������Ϣ�ˡ���

�����������X�����ϡ���L������������ͬ���r�Ӯ�Ƭ�еġ���N��һ�㣬�鱊���C�����x��ȫ�µ������`�꣬����ęC��չ�F��˼���c���_�ġ������S�����������_ʼ���������е�ÿһ�����䣬���hͨ��Ҳ�����ƄӃ��r�Ŀƻ�����ɞ����ìF����